WikiDer > Собственные значения и собственные векторы

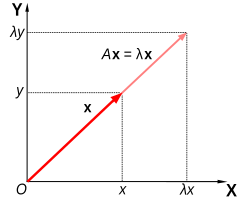

В линейная алгебра, собственный вектор (/ˈаɪɡəпˌvɛkтər/) или же характеристический вектор из линейное преобразование ненулевой вектор это меняется на скаляр коэффициент, когда к нему применяется это линейное преобразование. Соответствующие собственное значение, часто обозначаемый ,[1] - коэффициент масштабирования собственного вектора.

Геометрически, собственный вектор, соответствующий настоящий ненулевое собственное значение, указывает в направлении, в котором оно растянутый преобразованием, а собственное значение - коэффициент, на который он растягивается. Если собственное значение отрицательное, направление меняется на противоположное.[2] Грубо говоря, в многомерном векторное пространство, собственный вектор не поворачивается.

Формальное определение

Если Т является линейным преобразованием из векторного пространства V через поле F в себя и v это ненулевой вектор в V, тогда v является собственным вектором Т если Т(v) является скалярным кратным v. Это можно записать как

куда λ является скаляром в F, известный как собственное значение, характеристическое значение, или же характерный корень связана с v.

Существует прямая переписка между п-к-п квадратные матрицы и линейные преобразования из п-размерный векторное пространство в себя при любом основа векторного пространства. Следовательно, в конечномерном векторном пространстве это эквивалентно определять собственные значения и собственные векторы, используя любой язык матрицы, или язык линейных преобразований.[3][4]

Если V конечномерно, приведенное выше уравнение эквивалентно[5]

куда А является матричным представлением Т и ты - координатный вектор v.

Обзор

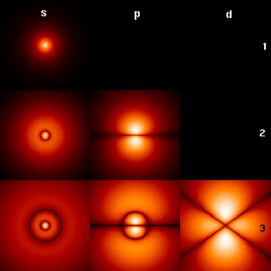

Собственные значения и собственные векторы занимают важное место при анализе линейных преобразований. Префикс собственный- взят из Немецкий слово собственный (соотносится с английский слово собственный) для «собственного», «характерного», «собственного».[6][7] Первоначально использовался для учебы главные оси вращательного движения твердые тела, собственные значения и собственные векторы имеют широкий спектр приложений, например, в анализ устойчивости, анализ вибрации, атомные орбитали, распознавание лиц, и диагонализация матрицы.

По сути, собственный вектор v линейного преобразования Т - ненулевой вектор, который при Т наносится на него, не меняет направления. Применение Т к собственному вектору масштабирует только собственный вектор на скалярное значение λ, называемое собственным значением. Это условие можно записать в виде уравнения

называется уравнение на собственные значения или же собственное уравнение. В целом, λ может быть любой скаляр. Например, λ может быть отрицательным, и в этом случае собственный вектор меняет направление на противоположное как часть масштабирования, или он может быть нулевым или сложный.

В Мона Лиза Пример, изображенный здесь, представляет собой простую иллюстрацию. Каждую точку на картине можно представить как вектор, указывающий от центра картины к этой точке. Линейное преобразование в этом примере называется картирование сдвига. Точки в верхней половине перемещаются вправо, а точки в нижней половине - влево, пропорционально тому, насколько они удалены от горизонтальной оси, проходящей через середину рисунка. Поэтому векторы, указывающие на каждую точку исходного изображения, наклоняются вправо или влево, а в результате преобразования становятся длиннее или короче. Точки вдоль горизонтальная ось вообще не перемещается при применении этого преобразования. Следовательно, любой вектор, который указывает прямо вправо или влево без вертикального компонента, является собственным вектором этого преобразования, поскольку отображение не меняет своего направления. Более того, все эти собственные векторы имеют собственное значение, равное единице, потому что отображение также не меняет их длину.

Линейные преобразования могут принимать множество различных форм, отображая векторы в различных векторных пространствах, поэтому собственные векторы также могут принимать разные формы. Например, линейное преобразование может быть дифференциальный оператор подобно , в этом случае собственные векторы являются функциями, называемыми собственные функции которые масштабируются этим дифференциальным оператором, например

В качестве альтернативы линейное преобразование может иметь форму п к п матрица, и в этом случае собственные векторы п на 1 матрицу. Если линейное преобразование выразить в виде п к п матрица А, то уравнение на собственные значения для линейного преобразования выше может быть переписано как матричное умножение

где собственный вектор v является п на 1 матрицу. Для матрицы собственные значения и собственные векторы могут использоваться для разложить матрицу- например, диагонализация Это.

Собственные значения и собственные векторы порождают множество тесно связанных математических понятий, и префикс собственный- широко применяется при их именовании:

- Набор всех собственных векторов линейного преобразования, каждый из которых спарен со своим соответствующим собственным значением, называется собственная система этой трансформации.[8][9]

- Множество всех собственных векторов Т соответствующая одному и тому же собственному значению вместе с нулевым вектором называется собственное подпространство, или характерное пространство из Т связанное с этим собственным значением.[10]

- Если набор собственных векторов Т образует основа области Т, то этот базис называется собственный базис.

История

Собственные значения часто вводятся в контексте линейная алгебра или же матричная теория. Однако исторически они возникли при изучении квадратичные формы и дифференциальные уравнения.

В 18 веке Леонард Эйлер изучал вращательное движение жесткое тело, и обнаружил важность главные оси.[а] Жозеф-Луи Лагранж понял, что главные оси - это собственные векторы матрицы инерции.[11]

В начале 19 века Огюстен-Луи Коши увидел, как их работу можно использовать для классификации квадратичные поверхности, и обобщил его до произвольных размеров.[12] Коши также ввел термин racine caractéristique (характерный корень), для того, что сейчас называется собственное значение; его срок выживает в характеристическое уравнение.[b]

Потом, Жозеф Фурье использовал работы Лагранжа и Пьер-Симон Лаплас решить уравнение теплопроводности к разделение переменных в его знаменитой книге 1822 года Теория аналитик де ля шалёр.[13] Шарль-Франсуа Штурм развил идеи Фурье и привлек к ним внимание Коши, который объединил их со своими собственными идеями и пришел к тому факту, что реальные симметричные матрицы имеют действительные собственные значения.[12] Это было продлено Чарльз Эрмит в 1855 г. до того, что сейчас называется Эрмитовы матрицы.[14]

Примерно в то же время Франческо Бриоски доказал, что собственные значения ортогональные матрицы лежать на единичный круг,[12] и Альфред Клебш нашел соответствующий результат для кососимметричные матрицы.[14] Ну наконец то, Карл Вейерштрасс прояснил важный аспект в теория устойчивости начал Лаплас, осознав, что дефектные матрицы может вызвать нестабильность.[12]

В это время, Джозеф Лиувиль изучал проблемы собственных значений, аналогичные задачам Штурма; дисциплина, выросшая из их работы, теперь называется Теория Штурма – Лиувилля.[15] Шварц изучил первое собственное значение Уравнение Лапласа на общих владениях ближе к концу 19 века, а Пуанкаре учился Уравнение Пуассона несколькими годами позже.[16]

В начале 20 века Дэвид Гильберт изучил собственные значения интегральные операторы рассматривая операторы как бесконечные матрицы.[17] Он был первым, кто использовал Немецкий слово собственный, что означает "собственный",[7] для обозначения собственных значений и собственных векторов в 1904 году,[c] хотя он, возможно, следил за подобным использованием Герман фон Гельмгольц. Некоторое время стандартным термином на английском языке было «собственное значение», но сегодня стандартом является более характерный термин «собственное значение».[18]

Первый численный алгоритм вычисления собственных значений и собственных векторов появился в 1929 году, когда Рихард фон Мизес опубликовал силовой метод. Один из самых популярных сегодня методов - QR-алгоритм, был предложен независимо Джон Г. Фрэнсис[19] и Вера Кублановская[20] в 1961 г.[21][22]

Собственные значения и собственные векторы матриц

Собственные значения и собственные векторы часто знакомятся со студентами в контексте курсов линейной алгебры, посвященных матрицам.[23][24]Кроме того, линейные преобразования в конечномерном векторном пространстве могут быть представлены с помощью матриц,[25][4] что особенно часто встречается в численных и вычислительных приложениях.[26]

Учитывать п-мерные векторы, которые формируются в виде списка п скаляры, такие как трехмерные векторы

Эти векторы называются скалярные кратные друг друга, или параллельно или же коллинеарен, если есть скаляр λ такой, что

В этом случае .

Теперь рассмотрим линейное преобразование п-мерные векторы, определяемые п к п матрица А,

или же

где для каждой строки

- .

Если это произойдет, v и ш являются скалярными кратными, то есть если

(1)

тогда v является собственный вектор линейного преобразования А и масштабный коэффициент λ это собственное значение соответствующий этому собственному вектору. Уравнение (1) это уравнение на собственные значения для матрицы А.

Уравнение (1) можно эквивалентно сформулировать как

(2)

куда я это п к п единичная матрица а 0 - нулевой вектор.

Собственные значения и характеристический многочлен

Уравнение (2) имеет ненулевое решение v если и только если в детерминант матрицы (А − λI) равно нулю. Следовательно, собственные значения А ценности λ которые удовлетворяют уравнению

(3)

С помощью Правило Лейбница для определителя левая часть уравнения (3) это многочлен функция переменной λ и степень этого полинома п, порядок матрицы А. Его коэффициенты зависят от записей А, за исключением того, что срок его степени п всегда (−1)пλп. Этот многочлен называется характеристический многочлен из А. Уравнение (3) называется характеристическое уравнение или светское уравнение из А.

В основная теорема алгебры следует, что характеристический многочлен п-к-п матрица А, будучи полиномом степени п, возможно учтенный в продукт п линейные члены,

(4)

где каждый λя может быть реальным, но в целом это комплексное число. Цифры λ1, λ2, ... λп, которые могут не иметь различных значений, являются корнями многочлена и собственными значениями А.

В качестве краткого примера, который более подробно описан в разделе примеров ниже, рассмотрим матрицу

Принимая определитель (А − λI), характеристический многочлен А является

Если положить характеристический полином равным нулю, он будет иметь корни в λ = 1 и λ = 3, которые являются двумя собственными значениями А. Собственные векторы, соответствующие каждому собственному значению, могут быть найдены путем решения для компонентов v в уравнении . В этом примере собственные векторы представляют собой любые ненулевые скалярные числа, кратные

Если элементы матрицы А все являются действительными числами, то коэффициенты характеристического полинома также будут действительными числами, но собственные значения могут по-прежнему иметь ненулевые мнимые части. Поэтому элементы соответствующих собственных векторов также могут иметь ненулевые мнимые части. Точно так же собственные значения могут быть иррациональные числа даже если все записи А находятся рациональное число или даже если все они целые. Однако если записи А все алгебраические числа, которые включают рациональные числа, собственные значения - комплексные алгебраические числа.

Неверные корни действительного многочлена с действительными коэффициентами можно сгруппировать в пары комплексные конъюгаты, а именно с двумя членами каждой пары, имеющими мнимые части, которые отличаются только знаком, и одинаковую действительную часть. Если степень нечетная, то по теорема о промежуточном значении по крайней мере, один из корней настоящий. Поэтому любой вещественная матрица с нечетным порядком имеет по крайней мере одно действительное собственное значение, тогда как вещественная матрица с четным порядком может не иметь никаких действительных собственных значений. Собственные векторы, связанные с этими комплексными собственными значениями, также являются комплексными и также входят в комплексно сопряженные пары.

Алгебраическая множественность

Позволять λя быть собственным значением п к п матрица А. В алгебраическая кратность μА(λя) собственного значения является его множественность как корень характеристического полинома, т. е. наибольшего целого числа k такой, что (λ − λя)k делится равномерно этот многочлен.[10][27][28]

Предположим матрицу А имеет размер п и d ≤ п различные собственные значения. Принимая во внимание, что уравнение (4) множит характеристический многочлен А в продукт п линейные члены с потенциально повторяющимися членами, характеристический многочлен может быть записан как произведение d члены, каждый из которых соответствует отдельному собственному значению и возведен в степень алгебраической кратности,

Если d = п то правая часть - произведение п линейные члены, и это то же самое, что и Уравнение (4). Размер алгебраической кратности каждого собственного значения связан с размерностью п в качестве

Если μА(λя) = 1, то λя считается простое собственное значение.[28] Если μА(λя) равна геометрической кратности λя, γА(λя), определенный в следующем разделе, то λя считается полупростое собственное значение.

Собственные подпространства, геометрическая кратность и собственный базис матриц

Учитывая конкретное собственное значение λ из п к п матрица Аопределить набор E быть всеми векторами v которые удовлетворяют уравнению (2),

С одной стороны, этот набор и есть ядро или пустое пространство матрицы (А − λI). С другой стороны, по определению, любой ненулевой вектор, удовлетворяющий этому условию, является собственным вектором А связана с λ. Итак, набор E это союз нулевого вектора с множеством всех собственных векторов А связана с λ, и E равно нулевому пространству (А − λI). E называется собственное подпространство или же характерное пространство из А связана с λ.[29][10] В целом λ - комплексное число, а собственные векторы - комплексные п на 1 матрицу. Свойство нулевого пространства состоит в том, что это линейное подпространство, так E является линейным подпространством в ℂп.

Потому что собственное подпространство E - линейное подпространство, это закрыто под дополнением. То есть, если два вектора ты и v принадлежат к множеству E, написано ты, v ∈ E, тогда (ты + v) ∈ E или эквивалентно А(ты + v) = λ(ты + v). Это можно проверить с помощью распределительное свойство матричного умножения. Точно так же, потому что E - линейное подпространство, замкнутое относительно скалярного умножения. То есть, если v ∈ E а α - комплексное число, (αv) ∈ E или эквивалентно А(αv) = λ(αv). Это можно проверить, отметив, что умножение комплексных матриц на комплексные числа коммутативный. Так долго как ты + v и αv не равны нулю, они также являются собственными векторами А связана с λ.

Размерность собственного подпространства E связана с λ, или, что то же самое, максимальное количество линейно независимых собственных векторов, связанных с λ, называется собственным значением геометрическая кратность γА(λ). Потому что E также является нулевым пространством (А − λI) геометрическая кратность λ - размерность нулевого пространства (А − λI), также называемый ничтожность из (А − λI), который относится к размерности и рангу (А − λI) в качестве

Из-за определения собственных значений и собственных векторов геометрическая кратность собственного значения должна быть не менее единицы, то есть каждое собственное значение имеет по крайней мере один связанный собственный вектор. Кроме того, геометрическая кратность собственного значения не может превышать его алгебраическую кратность. Кроме того, напомним, что алгебраическая кратность собственного значения не может превышать п.

Чтобы доказать неравенство рассмотрим, как из определения геометрической кратности следует существование ортонормированные собственные векторы , так что . Таким образом, мы можем найти (унитарную) матрицу чей первый столбцы являются этими собственными векторами, а оставшиеся столбцы могут быть любым ортонормированным набором векторы, ортогональные этим собственным векторам . потом имеет полный ранг и, следовательно, обратим, и с матрица, верхний левый блок которой является диагональной матрицей . Отсюда следует, что . Другими словами, похоже на , откуда следует, что . Но из определения мы знаем это содержит фактор , что означает, что алгебраическая кратность должен удовлетворить .

Предполагать имеет различные собственные значения , где геометрическая кратность является . Общая геометрическая кратность ,

это размер сумма всех собственных подпространств собственных значений, или, что то же самое, максимальное количество линейно независимых собственных векторов . Если , тогда

- Прямая сумма собственных подпространств всех собственные значения - это все векторное пространство .

- Основа может быть сформирован из линейно независимые собственные векторы ; такая основа называется собственный базис

- Любой вектор в можно записать как линейную комбинацию собственных векторов .

Дополнительные свойства собственных значений

Позволять быть произвольным матрица комплексных чисел с собственными значениями . Каждое собственное значение появляется раз в этом списке, где - алгебраическая кратность собственного значения. Ниже приведены свойства этой матрицы и ее собственных значений:

- В след из , определяемая как сумма его диагональных элементов, также является суммой всех собственных значений,

- В детерминант из является произведением всех собственных значений,

- Собственные значения th сила ; т.е. собственные значения , для любого положительного целого числа , находятся .

- Матрица является обратимый тогда и только тогда, когда каждое собственное значение ненулевое.

- Если обратима, то собственные значения находятся и геометрическая кратность каждого собственного значения совпадает. Более того, поскольку характеристический многочлен обратного обратный многочлен оригинала собственные значения имеют одинаковую алгебраическую кратность.

- Если равен своему сопряженный транспонировать , или эквивалентно, если является Эрмитский, то каждое собственное значение вещественно. То же самое и с любым симметричный вещественная матрица.

- Если не только эрмитский, но и положительно определенный, положительно-полуопределенный, отрицательно-определенный или отрицательно-полуопределенный, то каждое собственное значение будет положительным, неотрицательным, отрицательным или неположительным соответственно.

- Если является унитарный, каждое собственное значение имеет модуль .

- если это матрица и являются ее собственными значениями, то собственные значения матрицы (куда - единичная матрица) являются . Более того, если , собственные значения находятся . В более общем смысле, для полинома собственные значения матрицы находятся .

Левый и правый собственные векторы

Многие дисциплины традиционно представляют векторы как матрицы с одним столбцом, а не как матрицы с одной строкой. По этой причине слово «собственный вектор» в контексте матриц почти всегда относится к правый собственный вектор, а именно столбец вектор, который верно умножает матрица в определяющем уравнении Уравнение (1),

Задача на собственные значения и собственные векторы также может быть определена для ряд векторы, которые оставили матрица умножения . В этой формулировке определяющим уравнением является

куда скаляр и это матрица. Любой вектор-строка удовлетворяющий этому уравнению, называется левый собственный вектор из и ассоциированное с ним собственное значение. Транспонируя это уравнение,

Сравнивая это уравнение с уравнением (1), сразу следует, что левый собственный вектор то же самое, что транспонирование правого собственного вектора , с тем же собственным значением. Кроме того, поскольку характеристический многочлен совпадает с характеристическим полиномом , собственные значения левых собственных векторов такие же, как собственные значения правых собственных векторов .

Диагонализация и собственное разложение

Предположим, что собственные векторы А составляют основу, или что то же самое А имеет п линейно независимые собственные векторы v1, v2, ..., vп с соответствующими собственными значениями λ1, λ2, ..., λп. Собственные значения не обязательно должны быть разными. Определите квадратную матрицу Q чьи столбцы п линейно независимые собственные векторы А,

Поскольку каждый столбец Q является собственным вектором А, умножение вправо А к Q масштабирует каждый столбец Q по собственному значению,

Имея это в виду, определим диагональную матрицу Λ, где каждый диагональный элемент Λii - собственное значение, связанное с я-й столбец Q. потом

Поскольку столбцы Q линейно независимы, Q обратима. Справа, умножив обе части уравнения на Q−1,

или вместо этого умножая обе стороны слева на Q−1,

А поэтому может быть разложена на матрицу, состоящую из собственных векторов, диагональную матрицу с собственными значениями по диагонали и матрицу, обратную матрице собственных векторов. Это называется собственное разложение и это преобразование подобия. Такая матрица А как говорят похожий диагональной матрице Λ или диагонализуемый. Матрица Q - изменение базисной матрицы преобразования подобия. По сути, матрицы А и Λ представляют собой одно и то же линейное преобразование, выраженное в двух разных базах. Собственные векторы используются в качестве основы при представлении линейного преобразования как Λ.

Наоборот, предположим, что матрица А диагонализуема. Позволять п - невырожденная квадратная матрица такая, что п−1AP это некоторая диагональная матрица D. Осталось умножить оба на п, AP = PD. Каждый столбец п поэтому должен быть собственным вектором А собственное значение которого является соответствующим диагональным элементом D. Поскольку столбцы п должен быть линейно независимым для п быть обратимым, существуют п линейно независимые собственные векторы А. Отсюда следует, что собственные векторы матрицы А составляют основу тогда и только тогда, когда А диагонализуема.

Матрица, которая не диагонализуема, называется дефектный. Для дефектных матриц понятие собственных векторов обобщается на обобщенные собственные векторы а диагональная матрица собственных значений обобщается на Нормальная форма Джордана. Над алгебраически замкнутым полем любая матрица А имеет Нормальная форма Джордана и поэтому допускает базис из обобщенных собственных векторов и разложение на обобщенные собственные подпространства.

Вариационная характеристика

в Эрмитский В этом случае собственным значениям можно дать вариационную характеристику. Наибольшее собственное значение это максимальное значение квадратичная форма . Ценность который реализует этот максимум, является собственным вектором.

Примеры матриц

Пример двумерной матрицы

Рассмотрим матрицу

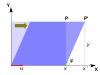

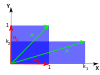

На рисунке справа показано влияние этого преобразования на координаты точки на плоскости. v этого преобразования удовлетворяют уравнению (1), а значения λ для которого определитель матрицы (А − λI) равны нулю - собственные значения.

Взяв определитель, чтобы найти характеристический многочлен А,

Если положить характеристический полином равным нулю, он будет иметь корни в λ=1 и λ=3, которые являются двумя собственными значениями А.

За λ=1, Уравнение (2) становится,

- ;

Любой ненулевой вектор с v1 = −v2 решает это уравнение. Следовательно,

является собственным вектором А соответствующий λ = 1, как и любое скалярное кратное этого вектора.

За λ=3, Уравнение (2) становится

- ;

Любой ненулевой вектор с v1 = v2 решает это уравнение. Следовательно,

является собственным вектором А соответствующий λ = 3, как и любое скалярное кратное этого вектора.

Таким образом, векторы vλ=1 и vλ=3 являются собственными векторами А связанные с собственными значениями λ=1 и λ=3, соответственно.

Пример трехмерной матрицы

Рассмотрим матрицу

Характеристический многочлен А является

Корни характеристического полинома равны 2, 1 и 11, которые являются единственными тремя собственными значениями А. Эти собственные значения соответствуют собственным векторам и , или любое ненулевое кратное ему.

Пример трехмерной матрицы с комплексными собственными значениями

Рассмотрим матрица циклической перестановки

Эта матрица сдвигает координаты вектора вверх на одну позицию и перемещает первую координату вниз. Его характеристический полином равен 1 -λ3, чьи корни

куда мнимая единица с

Для действительного собственного значения λ1 = 1, любой вектор с тремя равными ненулевыми элементами является собственным вектором. Например,

Для комплексно сопряженной пары мнимых собственных значений

потом

и

Следовательно, два других собственных вектора матрицы А сложные и и с собственными значениями λ2 и λ3, соответственно. Два комплексных собственных вектора также входят в комплексно сопряженную пару:

Пример диагональной матрицы

Матрицы с элементами только по главной диагонали называются диагональные матрицы. Собственные значения диагональной матрицы - это сами диагональные элементы. Рассмотрим матрицу

Характеристический многочлен А является

имеющий корни λ1=1, λ2=2, и λ3=3. Эти корни являются диагональными элементами, а также собственными значениямиА.

Каждый диагональный элемент соответствует собственному вектору, единственный ненулевой компонент которого находится в той же строке, что и этот диагональный элемент. В этом примере собственные значения соответствуют собственным векторам,

соответственно, а также скалярные кратные этих векторов.

Пример треугольной матрицы

Матрица, у которой все элементы над главной диагональю равны нулю, называется ниже треугольная матрица, а матрица, все элементы которой ниже главной диагонали равны нулю, называется верхнетреугольная матрица. Как и в случае диагональных матриц, собственные значения треугольных матриц являются элементами главной диагонали.

Рассмотрим нижнюю треугольную матрицу,

Характеристический многочлен А является

имеющий корни λ1=1, λ2=2, и λ3=3. Эти корни являются диагональными элементами, а также собственными значениямиА.

Эти собственные значения соответствуют собственным векторам,

соответственно, а также скалярные кратные этих векторов.

Пример матрицы с повторяющимися собственными значениями

Как и в предыдущем примере, нижняя треугольная матрица

имеет характеристический многочлен, который является произведением его диагональных элементов,

Корни этого многочлена, а следовательно, и собственные значения, равны 2 и 3. алгебраическая кратность каждого собственного значения 2; другими словами, они оба являются двойными корнями. Сумма алгебраических кратностей всех различных собственных значений равна μА = 4 = п, порядок характеристического полинома и размерность А.

С другой стороны, геометрическая кратность собственного значения 2 составляет всего 1, потому что его собственное подпространство охватывает только один вектор и поэтому одномерный. Точно так же геометрическая кратность собственного значения 3 равна 1, потому что его собственное подпространство натянуто только на один вектор . Общая геометрическая кратность γА равно 2, что является наименьшим значением для матрицы с двумя различными собственными значениями. Геометрические множественности определены в следующем разделе.

Тождество собственного вектора и собственного значения

Для Эрмитова матрица, квадрат нормы j-й компонент нормализованного собственного вектора может быть вычислен с использованием только собственных значений матрицы и собственных значений соответствующих малая матрица,

Собственные значения и собственные функции дифференциальных операторов

Определения собственного значения и собственных векторов линейного преобразования Т остается в силе, даже если лежащее в основе векторное пространство является бесконечномерным Гильберта или же Банахово пространство. Широко используемым классом линейных преобразований, действующих на бесконечномерные пространства, являются дифференциальные операторы на функциональные пространства. Позволять D - линейный дифференциальный оператор в пространстве C∞ бесконечно дифференцируемый реальные функции реального аргумента т. Уравнение на собственные значения для D это дифференциальное уравнение

Функции, удовлетворяющие этому уравнению, являются собственными векторами D и обычно называются собственные функции.

Пример производного оператора

Рассмотрим производный оператор с уравнением на собственные значения

Это дифференциальное уравнение можно решить, умножив обе части на dt/ж(т) и интегрируя. Его решение, экспоненциальная функция

- собственная функция производного оператора.В этом случае собственная функция сама является функцией связанного с ней собственного значения. В частности, для λ = 0 собственная функция ж(т) - постоянная.

Главный собственная функция В статье приведены другие примеры.

Общее определение

Понятие собственных значений и собственных векторов естественным образом распространяется на произвольные линейные преобразования на произвольных векторных пространствах. Позволять V любое векторное пространство над некоторым поле K из скаляры, и разреши Т отображение линейного преобразования V в V,

Мы говорим, что ненулевой вектор v ∈ V является собственный вектор из Т тогда и только тогда, когда существует скаляр λ ∈ K такой, что

(5)

Это уравнение называется уравнением на собственные значения для Т, а скаляр λ это собственное значение из Т соответствующий собственному вектору v. Т(v) является результатом применения преобразования Т к вектору v, пока λv это произведение скаляра λ с v.[38][39]

Собственные подпространства, геометрическая кратность и собственный базис

Учитывая собственное значение λ, рассмотрим множество

который представляет собой объединение нулевого вектора с множеством всех собственных векторов, связанных сλ. E называется собственное подпространство или же характерное пространство из Т связана сλ.

По определению линейного преобразования

за (Икс,у) ∈ V и α ∈ K. Следовательно, если ты и v являются собственными векторами Т связанный с собственным значением λ, а именно ты,v ∈ E, тогда

Итак, оба ты + v и αv являются либо нулевыми, либо собственными векторами Т связана с λ, а именно ты + v, αv ∈ E, и E замкнуто относительно сложения и скалярного умножения. Собственное подпространство E связана с λ поэтому является линейным подпространством в V.[40]Если это подпространство имеет размерность 1, его иногда называют собственная линия.[41]

В геометрическая кратность γТ(λ) собственного значения λ размерность собственного подпространства, связанного с λ, то есть максимальное количество линейно независимых собственных векторов, связанных с этим собственным значением.[10][28] По определению собственных значений и собственных векторов γТ(λ) ≥ 1, поскольку каждое собственное значение имеет хотя бы один собственный вектор.

Собственные подпространства Т всегда составлять прямая сумма. Как следствие, собственные векторы разные собственные значения всегда линейно независимы. Следовательно, сумма размеров собственных подпространств не может превышать размерности п векторного пространства, на котором Т действует, и не может быть больше, чем п различные собственные значения.[d]

Любое подпространство, порожденное собственными векторами Т является инвариантное подпространство из Т, а ограничение Т в такое подпространство диагонализуемо. Более того, если все векторное пространство V можно натянуть на собственные векторы Т, или, что то же самое, если прямая сумма собственных подпространств, связанных со всеми собственными значениями Т это все векторное пространство V, то основа V называется собственный базис могут быть сформированы из линейно независимых собственных векторов Т. Когда Т допускает собственный базис, Т диагонализуема.

Нулевой вектор как собственный вектор

Хотя определение собственного вектора, используемое в этой статье, исключает нулевой вектор, можно определить собственные значения и собственные векторы так, чтобы нулевой вектор был собственным вектором.[42]

Снова рассмотрим уравнение на собственные значения, Уравнение (5). Определить собственное значение быть любым скаляром λ ∈ K такой, что существует ненулевой вектор v ∈ V удовлетворяющее уравнению (5). Важно, чтобы в этой версии определения собственного значения указывается, что вектор не равен нулю, иначе по этому определению нулевой вектор допускает любой скаляр в K быть собственным значением. Определить собственный вектор v связанный с собственным значением λ быть любым вектором, который, учитывая λ, удовлетворяет уравнению (5). Учитывая собственное значение, нулевой вектор находится среди векторов, которые удовлетворяют уравнению (5), поэтому нулевой вектор включается в число собственных векторов этим альтернативным определением.

Спектральная теория

Если λ является собственным значением Т, то оператор (Т − λI) не взаимно однозначно, поэтому обратное (Т − λI)−1 не существует. Обратное верно для конечномерных векторных пространств, но не для бесконечномерных векторных пространств. В общем, оператор (Т − λI) может не иметь обратного, даже если λ не является собственным значением.

По этой причине в функциональный анализ собственные значения могут быть обобщены на спектр линейного оператора Т как набор всех скаляров λ для которого оператор (Т − λI) не имеет ограниченный обратный. Спектр оператора всегда содержит все его собственные значения, но не ограничивается ими.

Ассоциативные алгебры и теория представлений

Можно обобщить алгебраический объект, действующий в векторном пространстве, заменив единственный оператор, действующий в векторном пространстве, на представление алгебры - ан ассоциативная алгебра действуя на модуль. Изучение таких действий - область теория представлений.

В теоретико-репрезентативное понятие веса является аналогом собственных значений, а весовые векторы и весовые пространства являются аналогами собственных векторов и собственных подпространств соответственно.

Динамические уравнения

Простейший разностные уравнения иметь форму

Решение этого уравнения для Икс с точки зрения т находится с помощью его характеристического уравнения

которые можно найти, сложив в матрицу систему уравнений, состоящую из приведенного выше разностного уравнения и k - 1 уравнение давая k-мерная система первого порядка в векторе суммированных переменных в терминах его однократно запаздывающего значения и взятия характеристического уравнения матрицы этой системы. Это уравнение дает k характерные корни для использования в решении уравнения

Аналогичная процедура используется для решения дифференциальное уравнение формы

Расчет

Вычисление собственных значений и собственных векторов - это тема, в которой теория, представленная в учебниках элементарной линейной алгебры, часто очень далека от практики.

Классический метод

Классический метод состоит в том, чтобы сначала найти собственные значения, а затем вычислить собственные векторы для каждого собственного значения. Во многих отношениях он плохо подходит для неточной арифметики, такой как плавающая точка.

Собственные значения

Собственные значения матрицы можно определить, найдя корни характеристического многочлена. Это легко для матрицы, но сложность быстро увеличивается с увеличением размера матрицы.

Теоретически коэффициенты характеристического полинома можно вычислить точно, поскольку они являются суммами произведений матричных элементов; и есть алгоритмы, которые могут найти все корни многочлена произвольной степени до любой требуемой точность.[43] Однако на практике этот подход нежизнеспособен, поскольку коэффициенты будут загрязнены неизбежными ошибки округления, а корни полинома могут быть чрезвычайно чувствительной функцией коэффициентов (как показано на примере Полином Уилкинсона).[43] Даже для матриц, элементы которых являются целыми числами, вычисление становится нетривиальным, поскольку суммы очень велики; постоянный член - это детерминант, что для это сумма разные продукты.[e]

Явный алгебраические формулы так как корни многочлена существуют, только если степень 4 или меньше. Согласно Теорема Абеля – Руффини не существует общей, явной и точной алгебраической формулы для корней многочлена степени 5 или выше. (Общность имеет значение, потому что любой многочлен со степенью - характеристический многочлен некоторого сопутствующая матрица порядка .) Следовательно, для матриц порядка 5 и более собственные значения и собственные векторы не могут быть получены с помощью явной алгебраической формулы и, следовательно, должны быть вычислены с помощью приближенного численные методы. Даже точная формула для корней многочлена степени 3 численно нецелесообразно.

Собственные векторы

Как только (точное) значение собственного значения известно, соответствующие собственные векторы могут быть найдены путем нахождения ненулевых решений уравнения для собственных значений, которое становится система линейных уравнений с известными коэффициентами. Например, если известно, что 6 - собственное значение матрицы

мы можем найти его собственные векторы, решив уравнение , то есть

Это матричное уравнение эквивалентно двум линейные уравнения

- то есть

Оба уравнения сводятся к одному линейному уравнению . Следовательно, любой вектор вида , для любого ненулевого действительного числа , является собственным вектором с собственным значением .

Матрица выше имеет другое собственное значение . Аналогичный расчет показывает, что соответствующие собственные векторы являются ненулевыми решениями , то есть любой вектор вида , для любого ненулевого действительного числа .

Простые итерационные методы

Обратный подход, когда сначала ищут собственные векторы, а затем определяют каждое собственное значение по собственному вектору, оказывается гораздо более приемлемым для компьютеров. Самый простой алгоритм здесь состоит из выбора произвольного начального вектора и последующего многократного умножения его на матрицу (при необходимости нормализация вектора для сохранения его элементов разумного размера); это заставляет вектор сходиться к собственному вектору. Вариант вместо этого умножить вектор на ; это заставляет его сходиться к собственному вектору собственного значения, ближайшего к .

Если является (хорошим приближением) собственным вектором , то соответствующее собственное значение может быть вычислено как

куда обозначает сопряженный транспонировать из .

Современные методы

Эффективные и точные методы вычисления собственных значений и собственных векторов произвольных матриц не были известны до QR-алгоритм был разработан в 1961 году.[43] Объединение Преобразование домохозяина с разложением LU приводит к алгоритму с лучшей сходимостью, чем алгоритм QR.[нужна цитата] Для больших Эрмитский разреженные матрицы, то Алгоритм Ланцоша является одним из примеров эффективного итерационный метод для вычисления собственных значений и собственных векторов, среди нескольких других возможностей.[43]

Большинство численных методов, которые вычисляют собственные значения матрицы, также определяют набор соответствующих собственных векторов как побочный продукт вычисления, хотя иногда разработчики предпочитают отбрасывать информацию о собственном векторе, как только она больше не нужна.

Приложения

Собственные значения геометрических преобразований

В следующей таблице представлены некоторые примеры преобразований на плоскости вместе с их матрицами 2 × 2, собственными значениями и собственными векторами.

| Масштабирование | Неравномерное масштабирование | Вращение | Горизонтальный сдвиг | Гиперболическое вращение | |

|---|---|---|---|---|---|

| Иллюстрация |  |  |  |  | |

| Матрица | |||||

| Характеристика многочлен | |||||

| Собственные значения, | , | ||||

| Алгебраический мульт., | |||||

| Геометрический мульт., | |||||

| Собственные векторы | Все ненулевые векторы |

Характеристическое уравнение вращения - это квадратное уровненеие с дискриминант , которое является отрицательным числом всякий раз, когда θ не является целым числом, кратным 180 °. Следовательно, за исключением этих частных случаев, два собственных значения являются комплексными числами, ; и все собственные векторы имеют ненастоящие элементы. В самом деле, за исключением этих частных случаев, поворот изменяет направление любого ненулевого вектора на плоскости.

Линейное преобразование, превращающее квадрат в прямоугольник той же площади ( сжатие) имеет обратные собственные значения.

Уравнение Шредингера

Пример уравнения на собственные значения, в котором преобразование представлена в терминах дифференциального оператора. Уравнение Шредингера в квантовая механика:

куда , то Гамильтониан, является вторым порядком дифференциальный оператор и , то волновая функция, - одна из его собственных функций, соответствующая собственному значению , интерпретируется как его энергия.

Однако в случае, когда вас интересует только связанное состояние решения уравнения Шредингера, ищем в пространстве квадратично интегрируемый функции. Поскольку это пространство Гильбертово пространство с четко определенным скалярное произведениеможно ввести базисный набор в котором и может быть представлен как одномерный массив (т.е. вектор) и матрица соответственно. Это позволяет представить уравнение Шредингера в матричной форме.

В обозначение бюстгальтера часто используется в этом контексте. Вектор, который представляет состояние системы, в гильбертовом пространстве функций, интегрируемых с квадратом, представлен как . В этих обозначениях уравнение Шредингера имеет вид:

куда является собственное состояние из и представляет собственное значение. является наблюдаемый самосопряженный оператор, бесконечномерный аналог эрмитовых матриц. Как и в матричном случае, в приведенном выше уравнении под вектором, полученным преобразованием к .

Молекулярные орбитали

В квантовая механика, и в частности в атомный и молекулярная физика, в пределах Хартри – Фок теория, атомный и молекулярные орбитали можно определить собственными векторами Оператор Фока. Соответствующие собственные значения интерпретируются как потенциалы ионизации через Теорема Купманса. В этом случае термин собственный вектор используется в несколько более общем смысле, поскольку оператор Фока явно зависит от орбиталей и их собственных значений. Таким образом, если кто-то хочет подчеркнуть этот аспект, говорят о нелинейных задачах на собственные значения. Такие уравнения обычно решаются итерация процедура, вызываемая в этом случае самосогласованное поле метод. В квантовая химия, часто представляют уравнение Хартри – Фока в не-ортогональный базисный набор. Это конкретное представление является обобщенная задача на собственные значения называется Уравнения Рутана.

Геология и гляциология

В геология, особенно при изучении ледниковый до, собственные векторы и собственные значения используются в качестве метода, с помощью которого масса информации об ориентации и падении составляющих обломочной ткани может быть суммирована в трехмерном пространстве шестью числами. В полевых условиях геолог может собрать такие данные для сотен или тысяч Clasts в образце почвы, который можно сравнить только графически, например, на диаграмме Tri-Plot (Sneed and Folk),[44][45] или как стереосеть в сети Wulff.[46]

Выходные данные тензора ориентации находятся в трех ортогональных (перпендикулярных) осях пространства. Три собственных вектора упорядочены по собственным значениям ;[47] тогда это первичная ориентация / наклон обломка, вторичный и является высшим по силе. Ориентация кластера определяется как направление собственного вектора на картушка из 360°. Углубление измеряется как собственное значение, модуль тензора: он оценивается от 0 ° (без наклона) до 90 ° (по вертикали). Относительные значения , , и продиктованы природой ткани осадка. Если ткань называется изотропной. Если ткань называется плоской. Если ткань называется линейной.[48]

Анализ главных компонентов

В собственное разложение из симметричный положительно полуопределенный (PSD) матрица дает ортогональный базис собственных векторов, каждый из которых имеет неотрицательное собственное значение. Ортогональное разложение матрицы PSD используется в многомерный анализ, где образец ковариационные матрицы являются PSD. Это ортогональное разложение называется Анализ главных компонентов (PCA) в статистике. Исследования PCA линейные отношения среди переменных. PCA выполняется на ковариационная матрица или корреляционная матрица (в котором каждая переменная масштабируется, чтобы иметь выборочная дисперсия равно единице). Для ковариационной или корреляционной матрицы собственные векторы соответствуют основные компоненты и собственные значения объяснение расхождения по основным компонентам. Анализ главных компонент корреляционной матрицы дает ортогональный базис для пространства наблюдаемых данных: в этом базисе наибольшие собственные значения соответствуют основным компонентам, которые связаны с большей частью ковариабельности среди ряда наблюдаемых данных.

Анализ главных компонентов используется как средство уменьшение размерности в изучении больших наборы данных, например, встречающиеся в биоинформатика. В Q методология, собственные значения корреляционной матрицы определяют суждение Q-методиста о практичный значение (которое отличается от Статистическая значимость из проверка гипотезы; ср. критерии определения количества факторов). В более общем смысле, анализ главных компонентов можно использовать как метод факторный анализ в структурное моделирование уравнение.

Анализ вибрации

Проблемы собственных значений возникают естественным образом при анализе вибрации механических конструкций со многими степени свободы. Собственные значения - это собственные частоты (или собственные частоты) колебания, а собственные векторы - формы этих колебательных мод. В частности, незатухающая вибрация регулируется

или же

то есть ускорение пропорционально положению (т.е. мы ожидаем быть синусоидальной по времени).

В размеры, становится матрица масс и а матрица жесткости. Допустимые решения представляют собой линейную комбинацию решений обобщенная задача на собственные значения

куда - собственное значение и это (воображаемый) угловая частота. Основные моды колебаний отличаются от основных мод податливости, которые являются собственными векторами один. Более того, затухающая вибрация, регулируется

приводит к так называемому квадратичная задача на собственные значения,

Это можно свести к обобщенной проблеме собственных значений с помощью алгебраические манипуляции ценой решения более крупной системы.

Свойства ортогональности собственных векторов позволяют разделить дифференциальные уравнения, так что система может быть представлена как линейное суммирование собственных векторов. Проблема собственных значений сложных структур часто решается с использованием анализ методом конечных элементов, но аккуратно обобщают решение задач вибрации со скалярными значениями.

Eigenfaces

В обработка изображенийобработанные изображения лиц можно рассматривать как векторы, компонентами которых являются яркость каждого пиксель.[49] Размерность этого векторного пространства - это количество пикселей. Собственные векторы ковариационная матрица связанные с большим набором нормализованных изображений лиц, называются собственные лица; это пример Анализ главных компонентов. Они очень полезны для выражения любого изображения лица в виде линейная комбинация некоторых из них. в распознавание лиц филиал биометрия, собственные грани позволяют применять Сжатие данных к лицам для идентификация целей. Также были проведены исследования, связанные с системами собственного зрения, определяющими жесты рук.

Подобно этой концепции, собственные голоса представляют собой общее направление вариабельности человеческого произношения определенного высказывания, например слова на языке. На основе линейной комбинации таких собственных голосов можно построить новое голосовое произношение слова. Эти концепции оказались полезными в системах автоматического распознавания речи для адаптации говорящего.

Тензор момента инерции

В механика, собственные векторы тензор момента инерции определить главные оси из жесткое тело. В тензор момента инерция - ключевая величина, необходимая для определения вращения твердого тела вокруг его центр массы.

Тензор напряжения

В механика твердого тела, то стресс тензор симметричен и поэтому может быть разложен на диагональ тензор с собственными числами на диагонали и собственными векторами в качестве основы. Поскольку он диагонален, в этой ориентации тензор напряжений не имеет срезать составные части; компоненты, которые он имеет, являются основными компонентами.

Графики

В спектральная теория графов, собственное значение график определяется как собственное значение графа матрица смежности , или (все чаще) графа Матрица лапласа из-за его дискретный оператор Лапласа, который либо (иногда называют комбинаторный лапласиан) или же (иногда называют нормализованный лапласиан), куда диагональная матрица с равный степени вершины , И в , то й диагональный вход . В -й главный собственный вектор графа определяется как собственный вектор, соответствующий th по величине или -е наименьшее собственное значение лапласиана. Первый главный собственный вектор графа также называется просто главным собственным вектором.

Главный собственный вектор используется для измерения центральность его вершин. Примером является Googleс PageRank алгоритм. Главный собственный вектор модифицированного матрица смежности графа World Wide Web дает странице ранги в качестве ее компонентов. Этот вектор соответствует стационарное распределение из Цепь Маркова представлен нормализованной по строкам матрицей смежности; однако сначала необходимо изменить матрицу смежности, чтобы гарантировать существование стационарного распределения. Второй наименьший собственный вектор можно использовать для разделения графа на кластеры с помощью спектральная кластеризация. Также доступны другие методы кластеризации.

Базовый номер репродукции

Базовый номер репродукции () является фундаментальным числом в изучении распространения инфекционных заболеваний. Если поместить одного инфекционного человека в группу полностью восприимчивых людей, то это среднее количество людей, которых заразит один типичный инфекционный человек. Время зарождения инфекции - это время, , от заражения одного человека к другому. В неоднородной популяции матрица следующего поколения определяет, сколько человек в популяции заразится через некоторое время. прошел. тогда является наибольшим собственным значением матрицы следующего поколения.[50][51]

Смотрите также

- Теория антисобственных значений

- Собственный оператор

- Eigenplane

- Алгоритм собственных значений

- Введение в собственные состояния

- Нормальная форма Джордана

- Список программного обеспечения для численного анализа

- Нелинейная проблема собственных значений

- Нормальное собственное значение

- Квадратичная проблема собственных значений

- Особое значение

- Спектр матрицы

Примечания

- ^ Примечание:

- В 1751 году Леонард Эйлер доказал, что любое тело имеет главную ось вращения: Леонард Эйлер (представлено: октябрь 1751; опубликовано: 1760) "Du mouvement d'un corps solide quelconque lorsqu'il tourne autour d'un ax mobile" (О движении любого твердого тела при его вращении вокруг движущейся оси), Histoire de l'Académie Royale des Sciences et des Belles Lettres de BerlinС. 176–227. На стр. 212, Эйлер доказывает, что любое тело содержит главную ось вращения: "Теорема. 44. De quelque figure que soit le corps, on y peut toujours assigner un tel ax, qui pas par son center de gravité, autour duquel le corps peut tourner librement & d'un mouvement uniforme". (Теорема 44. Какой бы ни была форма тела, ему всегда можно присвоить такую ось, которая проходит через его центр тяжести, вокруг которого оно может вращаться свободно и равномерно.)

- В 1755 г. Иоганн Андреас Сегнер доказал, что любое тело имеет три главные оси вращения: Иоганн Андреас Сегнер, Образец theoriae turbinum [Очерк теории вершин (т. Е. Вращающихся тел)] (Halle («Halae»), (Германия): Gebauer, 1755). (https://books.google.com/books?id=29 п. xxviiii [29]), Сегнер выводит уравнение третьей степени в т, что доказывает наличие у тела трех главных осей вращения. Затем он заявляет (на той же странице): «Non autem repugnat tres esse eiusmodi positiones plani HM, quia in aequatione cubica radices tres esse Possunt, et tres tangentis t valores». (Однако это не противоречит [наличие] трех таких положений плоскости HM, потому что в кубических уравнениях [там] может быть три корня и три значения касательной t.)

- Соответствующий отрывок из работы Сегнера был кратко обсужден Артур Кэли. См .: А. Кэли (1862 г.) «Отчет о ходе решения некоторых специальных задач динамики». Отчет о тридцать втором заседании Британской ассоциации содействия развитию науки; состоялась в Кембридже в октябре 1862 г., 32: 184–252; особенно видеть С. 225–226.

- ^ Клайн 1972, стр. 807–808 Огюстен Коши (1839) "Mémoire sur l'intégration des équations linéaires" (Мемуар об интегрировании линейных уравнений), Comptes rendus, 8: 827–830, 845–865, 889–907, 931–937. С п. 827: "On sait d'ailleurs qu'en suivant la méthode de Lagrange, on obtient pour valeur générale de la variable prinicipale une fonction dans laquelle entrent avec la variable Principale les racines d'une sure équation que j'appellerai l 'équation caractéristique, le degré de cette équation étant précisément l'order de l'équation différentielle qu'il s'agit d'intégrer ". (Более того, известно, что следуя методу Лагранжа, для общего значения главной переменной получают функцию, в которой вместе с главной переменной появляются корни определенного уравнения, которое я назову «характеристическим уравнением». (степень этого уравнения является в точности порядком дифференциального уравнения, которое необходимо проинтегрировать.)

- ^ Видеть:

- Дэвид Гильберт (1904) "Grundzüge einer allgemeinen Theorie der linearen Integralgleichungen. (Erste Mitteilung)" (Основы общей теории линейных интегральных уравнений. (Первое сообщение)), Nachrichten von der Gesellschaft der Wissenschaften zu Göttingen, Mathematisch-Physikalische Klasse (Новости Философского общества в Геттингене, математико-физический раздел), стр. 49–91. С п. 51: "Insbesondere in dieser ersten Mitteilung gelange ich zu Formeln, die Entwickelung einer willkürlichen Funktion nach gewissen ausgezeichneten Funktionen, die ich 'Eigenfunktionen' nenne, liefern: ..." (В частности, в этом первом отчете я прихожу к формулам, которые обеспечивают [последовательное] развитие произвольной функции в терминах некоторых отличительных функций, которые я называю собственные функции:…) Позже на той же странице: «Dieser Erfolg ist wesentlich durch den Umstand bedingt, daß ich nicht, wie es bisher geschah, in erster Linie auf den Beweis für die Existenz der Eigenwerte ausgehe,…» (Этот успех в основном объясняется тем фактом, что я, как это происходило до сих пор, не ставлю своей целью прежде всего доказательство существования собственных значений, ...)

- О происхождении и эволюции терминов собственное значение, характеристическое значение и т. Д. См .: Самые ранние известные варианты использования некоторых слов математики (E)

- ^ Доказательство этой леммы см. Роман 2008, Теорема 8.2 на с. 186; Шилов 1977, п. 109; Хефферон 2001, п. 364; Beezer 2006, Теорема EDELI на с. 469; и Лемма о линейной независимости собственных векторов

- ^ При выполнении Гауссово исключение над формальный степенной ряд усечено до условия, которые можно избежать операции, но это не требует комбинаторный взрыв в учетную запись.

Цитаты

- ^ «Исчерпывающий список символов алгебры». Математическое хранилище. 25 марта 2020 г.. Получено 19 августа 2020.

- ^ Бремя и ярмарки 1993, п. 401.

- ^ Герштейн 1964С. 228, 229.

- ^ а б Неринг 1970, п. 38.

- ^ Вайсштейн, Эрик В. «Собственное значение». mathworld.wolfram.com. Получено 19 августа 2020.

- ^ Беттеридж 1965.

- ^ а б «Собственный вектор и собственное значение». www.mathsisfun.com. Получено 19 августа 2020.

- ^ Press et al. 2007 г., п. 536.

- ^ Wolfram.com: собственный вектор.

- ^ а б c d Неринг 1970, п. 107.

- ^ Хокинс 1975, §2.

- ^ а б c d Хокинс 1975, §3.

- ^ Клайн 1972, п. 673.

- ^ а б Клайн 1972С. 807–808.

- ^ Клайн 1972С. 715–716.

- ^ Клайн 1972С. 706–707.

- ^ Клайн 1972, п. 1063, стр ..

- ^ Олдрич 2006.

- ^ Фрэнсис 1961С. 265–271.

- ^ Кублановская 1961С. 637–657.

- ^ Голуб и Ван Лоан 1996, §7.3.

- ^ Мейер 2000, §7.3.

- ^ Математический факультет Корнельского университета (2016) Курсы начального уровня для первокурсников и второкурсников. Проверено 27 марта 2016 г.

- ^ Математический университет Мичигана (2016) Каталог курсов математики В архиве 2015-11-01 на Wayback Machine. Проверено 27 марта 2016 г.

- ^ Герштейн 1964, pp. 228, 229.

- ^ Press et al. 2007 г., п. 38.

- ^ Фрали 1976, п. 358.

- ^ а б c Голуб и Ван Лоан 1996, п. 316.

- ^ Антон 1987, pp. 305,307.

- ^ а б Борегар и Фрали 1973, п. 307.

- ^ Герштейн 1964, п. 272.

- ^ Неринг 1970С. 115–116.

- ^ Герштейн 1964, п. 290.

- ^ Неринг 1970, п. 116.

- ^ Волчонок 2019.

- ^ Denton et al. 2019 г..

- ^ Ван Мигем 2014.

- ^ Korn & Korn 2000, Раздел 14.3.5a.

- ^ Фридберг, Инзель и Спенс 1989, п. 217.

- ^ Неринг 1970, п. 107; Шилов 1977, п. 109 Лемма для собственного подпространства

- ^ Липшуц и Липсон 2002, п. 111.

- ^ Axler, п. 77.

- ^ а б c d Trefethen & Bau 1997.

- ^ Грэм и Мидгли 2000С. 1473–1477.

- ^ Снид и Фолк 1958С. 114–150.

- ^ Нокс-Робинсон и Гардолл 1998, п. 243.

- ^ Программное обеспечение Stereo32

- ^ Бенн и Эванс 2004С. 103–107.

- ^ Xirouhakis, Votsis & Delopoulus 2004.

- ^ Журнал математической биологии 1990С. 365–382.

- ^ Хестербик и Дикманн 2000.

Источники

- Акивис, Макс А .; Гольдберг, Владислав В. (1969), Тензорное исчисление, Россия, Наука, Москва

- Олдрич, Джон (2006), «Собственное значение, собственная функция, собственный вектор и связанные с ними термины», Миллер, Джефф (ред.), Самые ранние известные варианты использования некоторых слов математики

- Александров, Павел С. (1968), Конспект лекций по аналитической геометрии, Россия, Наука, Москва[ISBN отсутствует]

- Антон, Ховард (1987), Элементарная линейная алгебра (5-е изд.), Нью-Йорк: Wiley, ISBN 0-471-84819-0

- Акслер, Шелдон, Линейная алгебра сделано правильно (3-е изд.), Springer, p. 77, ISBN 978-3-319-30765-7

- Beauregard, Raymond A .; Фрали, Джон Б. (1973), Первый курс линейной алгебры: с дополнительным введением в группы, кольца и поля, Бостон: Houghton Mifflin Co., ISBN 0-395-14017-X

- Бизер, Роберт А. (2006), Первый курс линейной алгебры, Бесплатная онлайн-книга под лицензией GNU, Университет Пьюджет-Саунд

- Benn, D .; Эванс, Д. (2004), Практическое руководство по изучению ледниковых отложений, Лондон: Арнольд, стр. 103–107.

- Беттеридж, Гарольд Т. (1965), Новый словарь немецкого языка Касселла, Нью-Йорк: Фанк и Вагналл, LCCN 58-7924

- Bowen, Ray M .; Ван, Чао-Чэн (1980), Линейная и полилинейная алгебра, Plenum Press, Нью-Йорк, ISBN 0-306-37508-7

- Бэрден, Ричард Л .; Фэрс, Дж. Дуглас (1993), Числовой анализ (5-е изд.), Бостон: Принл, Вебер и Шмидт, ISBN 0-534-93219-3

- Картер, Тамара А .; Тапиа, Ричард А .; Папаконстантину, Анна, Линейная алгебра: введение в линейную алгебру для студентов, изучающих математику, Университет Райса, Интернет-издание, получено 19 февраля 2008

- Коэн-Таннуджи, Клод (1977), "Глава II. Математический аппарат квантовой механики", Квантовая механика, Джон Уайли и сыновья, ISBN 0-471-16432-1

- Кертис, Чарльз В. (1999), Линейная алгебра: вводный подход (4-е изд.), Springer, ISBN 0-387-90992-3

- Деммель, Джеймс У. (1997), Прикладная числовая линейная алгебра, СИАМ, ISBN 0-89871-389-7

- Дентон, Питер Б .; Парк, Стивен Дж .; Тао, Теренс; Чжан, Синин (10 августа 2019 г.). «Собственные векторы из собственных значений: обзор основного тождества в линейной алгебре». arXiv:1908.03795 [math.RA].

- Diekmann O, Heesterbeek JA, Metz JA (1990), "Об определении и вычислении базового коэффициента воспроизводства R0 в моделях инфекционных заболеваний в гетерогенных популяциях", Журнал математической биологии, 28 (4): 365–382, Дои:10.1007 / BF00178324, HDL:1874/8051, PMID 2117040, S2CID 22275430

- Фрали, Джон Б. (1976), Первый курс абстрактной алгебры (2-е изд.), Литература: Эддисон-Уэсли, ISBN 0-201-01984-1

- Fraleigh, John B .; Борегар, Раймонд А. (1995), Линейная алгебра (3-е изд.), Издательство Addison-Wesley Publishing Company, ISBN 0-201-83999-7

- Фрэнсис, Дж. Г. Ф. (1961), "Преобразование QR, I (часть 1)", Компьютерный журнал, 4 (3): 265–271, Дои:10.1093 / comjnl / 4.3.265и Фрэнсис, Дж. Г. Ф. (1962), "Преобразование QR, II (часть 2)", Компьютерный журнал, 4 (4): 332–345, Дои:10.1093 / comjnl / 4.4.332

- Фрэнсис, Дж. Г. Ф. (1962), "Преобразование QR, II (часть 2)", Компьютерный журнал, 4 (4): 332–345, Дои:10.1093 / comjnl / 4.4.332

- Фридберг, Стивен Х .; Insel, Arnold J .; Спенс, Лоуренс Э. (1989), Линейная алгебра (2-е изд.), Englewood Cliffs, NJ: Prentice Hall, ISBN 0-13-537102-3

- Гельфанд, И. М. (1971), Конспект лекций по линейной алгебре, Россия, Наука, Москва

- Гохберг, Израиль; Ланкастер, Питер; Родман, Лейба (2005), Неопределенная линейная алгебра и приложения, Базель, Бостон, Берлин: Birkhäuser Verlag, ISBN 3-7643-7349-0

- Голуб, Джин Ф .; ван дер Ворст, Хенк А. (2000), «Вычисление собственных значений в 20 веке» (PDF), Журнал вычислительной и прикладной математики, 123 (1–2): 35–65, Bibcode:2000JCoAM.123 ... 35 г, Дои:10.1016 / S0377-0427 (00) 00413-1

- Голуб, Джин Х.; Ван Лоан, Чарльз Ф. (1996), Матричные вычисления (3-е изд.), Балтимор, Мэриленд: Издательство Университета Джона Хопкинса, ISBN 978-0-8018-5414-9

- Graham, D .; Мидгли, Н. (2000), "Графическое представление формы частиц с помощью треугольных диаграмм: метод электронных таблиц Excel", Процессы земной поверхности и формы рельефа, 25 (13): 1473–1477, Bibcode:2000ESPL ... 25,1473 г, Дои:10.1002 / 1096-9837 (200012) 25:13 <1473 :: AID-ESP158> 3.0.CO; 2-C, S2CID 128825838

- Greub, Вернер Х. (1975), Линейная алгебра (4-е изд.), Нью-Йорк: Springer-Verlag, ISBN 0-387-90110-8

- Халмос, Пол Р. (1987), Конечномерные векторные пространства (8-е изд.), Нью-Йорк: Springer-Verlag, ISBN 0-387-90093-4

- Хокинс, Т. (1975), "Коши и спектральная теория матриц", Historia Mathematica, 2: 1–29, Дои:10.1016/0315-0860(75)90032-4

- Heesterbeek, J. A. P .; Дикманн, Одо (2000), Математическая эпидемиология инфекционных болезней, Серия Wiley по математической и вычислительной биологии, Западный Суссекс, Англия: John Wiley & Sons

- Хефферон, Джим (2001), Линейная алгебра, Колчестер, VT: Интернет-книга, Колледж Святого Михаила

- Герштейн, И. Н. (1964), Темы по алгебре, Уолтем: Издательство Blaisdell, ISBN 978-1114541016

- Хорн, Роджер А .; Джонсон, Чарльз Ф. (1985), Матричный анализ, Издательство Кембриджского университета, ISBN 0-521-30586-1

- Клайн, Моррис (1972), Математическая мысль с древних времен до наших дней, Издательство Оксфордского университета, ISBN 0-19-501496-0

- Knox-Robinson, C .; Гардолл, Стивен Дж. (1998), "ГИС-стереоплот: интерактивный модуль построения стереосетей для географической информационной системы ArcView 3.0", Компьютеры и науки о Земле, 24 (3): 243, Bibcode:1998CG ..... 24..243K, Дои:10.1016 / S0098-3004 (97) 00122-2

- Корн, Гранино А .; Корн, Тереза М. (2000), «Математический справочник для ученых и инженеров: определения, теоремы и формулы для справки и обзора», Нью-Йорк: Макгроу-Хилл (2-е пересмотренное изд.), Bibcode:1968мхсе.книга ..... K, ISBN 0-486-41147-8

- Кублановская, Вера Н. (1961), "О некоторых алгоритмах решения полной проблемы собственных значений", Вычислительная математика и математическая физика СССР, 3: 637–657. Также опубликовано в: «О некоторых алгоритмах для решения полной проблемы собственных значений» [О некоторых алгоритмах решения полной проблемы собственных значений], Журнал вычислительной математики и математической физики (Журнал вычислительной математики и математической физики) (на русском), 1 (4): 555–570, 1961

- Каттлер, Кеннет (2007), Введение в линейную алгебру (PDF), Университет Бригама Янга

- Ланкастер, П. (1973), Матричная теория, Русский, Москва: Издательство Наука.

- Ларсон, Рон; Эдвардс, Брюс Х. (2003), Элементарная линейная алгебра (5-е изд.), Houghton Mifflin Company, ISBN 0-618-33567-6

- Липшуц, Сеймур (1991), Очерк теории и проблем линейной алгебры Шаума, Серия набросков Шаума (2-е изд.), Нью-Йорк: McGraw-Hill Companies, ISBN 0-07-038007-4

- Липшуц, Сеймур; Липсон, Марк (12 августа 2002 г.). Простая схема линейной алгебры Шаума. McGraw Hill Professional. п. 111. ISBN 978-007139880-0.

- Мейер, Карл Д. (2000), Матричный анализ и прикладная линейная алгебра, Филадельфия: Общество промышленной и прикладной математики (SIAM), ISBN 978-0-89871-454-8

- Неринг, Эвар Д. (1970), Линейная алгебра и теория матриц (2-е изд.), Нью-Йорк: Wiley, LCCN 76091646

- Press, William H .; Теукольский, Саул А.; Веттерлинг, Уильям Т .; Фланнери, Брайан П. (2007), Числовые рецепты: искусство научных вычислений (3-е изд.), ISBN 978-0521880688

- Роман, Стивен (2008), Продвинутая линейная алгебра (3-е изд.), Нью-Йорк: Springer Science + Business Media, ISBN 978-0-387-72828-5

- Шарипов, Руслан А. (1996), Курс линейной алгебры и многомерной геометрии: учебник, arXiv:математика / 0405323, Bibcode:2004математика ...... 5323S, ISBN 5-7477-0099-5

- Шилов, Георгий Э. (1977), Линейная алгебра, Перевод и редакция Ричарда А. Сильвермана, Нью-Йорк: Dover Publications, ISBN 0-486-63518-X

- Шорс, Томас С. (2007), Прикладная линейная алгебра и матричный анализ, Springer Science + Business Media, ISBN 978-0-387-33194-2

- Sneed, E.D .; Фолк, Р. Л. (1958), "Галька в нижнем течении реки Колорадо, Техас, исследование морфогенеза частиц", Журнал геологии, 66 (2): 114–150, Bibcode:1958JG ..... 66..114S, Дои:10.1086/626490, S2CID 129658242

- Стрэнг, Гилберт (1993), Введение в линейную алгебру, Уэлсли, Массачусетс: Wellesley-Cambridge Press, ISBN 0-9614088-5-5

- Стрэнг, Гилберт (2006), Линейная алгебра и ее приложения, Бельмонт, Калифорния: Томсон, Брукс / Коул, ISBN 0-03-010567-6

- Trefethen, Lloyd N .; Бау, Дэвид (1997), Числовая линейная алгебра, СИАМ

- Ван Мигхем, Пит (18 января 2014 г.). «Графические собственные векторы, фундаментальные веса и метрики центральности для узлов в сетях». arXiv:1401.4580 [math.SP].

- Вайсштейн, Эрик В. «Собственный вектор». mathworld.wolfram.com. Получено 4 августа 2019.

- Вулховер, Натали (13 ноября 2019 г.). «Нейтрино приводят к неожиданным открытиям в основах математики». Журнал Quanta. Получено 27 ноября 2019.

- Xirouhakis, A .; Вотсис, Г .; Делопул, А. (2004), Оценка трехмерного движения и структуры человеческих лиц (PDF), Национальный технический университет Афин

- (на русском)Пиголкина, Т. С .; Шульман, В. С. (1977). «Собственное значение». В Виноградове, И. М. (ред.). Математическая энциклопедия. 5. Москва: Советская энциклопедия.

дальнейшее чтение

- "Руководство по собственным векторам для начинающих". Deeplearning4j. 2015. Архивировано с оригинал 21 июля 2018 г.. Получено 18 августа 2015.

- Хилл, Роджер (2009). «λ - собственные значения». Шестьдесят символов. Брэди Харан для Ноттингемский университет.

внешняя ссылка

Эта статья использование внешняя ссылка может не следовать политикам или рекомендациям Википедии. (Декабрь 2019 г.) (Узнайте, как и когда удалить этот шаблон сообщения) |

| Викибук Линейная алгебра есть страница по теме: Собственные значения и собственные векторы |

- Что такое собственные значения? - Нетехническая вводная информация от PhysLink.com "Спроси экспертов"

- Численные примеры собственных значений и собственных векторов - Обучающая и интерактивная программа от Revoledu.

- Введение в собственные векторы и собственные значения - лекция из Ханской академии

- Собственные векторы и собственные значения | Сущность линейной алгебры, глава 10 - Визуальное объяснение с 3Синий 1Коричневый

- Калькулятор собственных векторов матрицы из Symbolab (Нажмите нижнюю правую кнопку сетки 2x12, чтобы выбрать размер матрицы. Выберите размер (для квадратной матрицы), затем введите числовые значения и нажмите кнопку «Перейти». Он также может принимать комплексные числа.)

Теория

- «Собственное значение», Энциклопедия математики, EMS Press, 2001 [1994]

- «Собственный вектор», Энциклопедия математики, EMS Press, 2001 [1994]

- «Собственное значение (матрицы)». PlanetMath.

- Собственный вектор - Вольфрам MathWorld

- Рабочий апплет Eigen Vector Examination

- Тот же анализ собственных векторов, что и выше, во флэш-демо со звуком

- Вычисление собственных значений

- Численное решение задач на собственные значения Под редакцией Чжаоцзюнь Бая, Джеймс Деммел, Джек Донгарра, Аксель Рухе и Хенк ван дер Ворст

- Собственные значения и собственные векторы на форумах Ask Dr. Math: [1], [2]

![{ displaystyle { bigl [} { begin {smallmatrix} 2 & 1 1 & 2 end {smallmatrix}} { bigr]}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/dcacd8bee0f5c4d9f5e8e3fc2c4932447e0e2aec)

![{ displaystyle { begin {align} | A- lambda I | & = left | { begin {bmatrix} 2 & 1 1 & 2 end {bmatrix}} - lambda { begin {bmatrix} 1 & 0 0 & 1 end {bmatrix}} right | = { begin {vmatrix} 2- lambda & 1 1 & 2- lambda end {vmatrix}}, [6pt] & = 3-4 lambda + lambda ^ {2}. End {выравнивается}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/616c8bf6fe953c6bfbda5132efcdf799d4f13ced)

![{ displaystyle { begin {align} | A- lambda I | & = left | { begin {bmatrix} 2 & 0 & 0 0 & 3 & 4 0 & 4 & 9 end {bmatrix}} - lambda { begin {bmatrix} 1 & 0 & 0 0 & 1 & 0 0 & 0 & 1 end {bmatrix}} right | = { begin {vmatrix} 2- lambda & 0 & 0 0 & 3- lambda & 4 0 & 4 & 9- lambda end {vmatrix}}, [ 6pt] & = (2- lambda) { bigl [} (3- lambda) (9- lambda) -16 { bigr]} = - lambda ^ {3} +14 lambda ^ {2} -35 лямбда +22. Конец {выровнено}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/30165fb86a7e23644d2e3373a1c2c68af4756523)